A Meta anunciou nesta terça-feira, dia 9, um novo modelo de inteligência artificial (IA) de código aberto. O ImageBind é capaz de combinar seis modalidades de informações, o que promete uma capacidade de aprendizado mais próxima da humana.

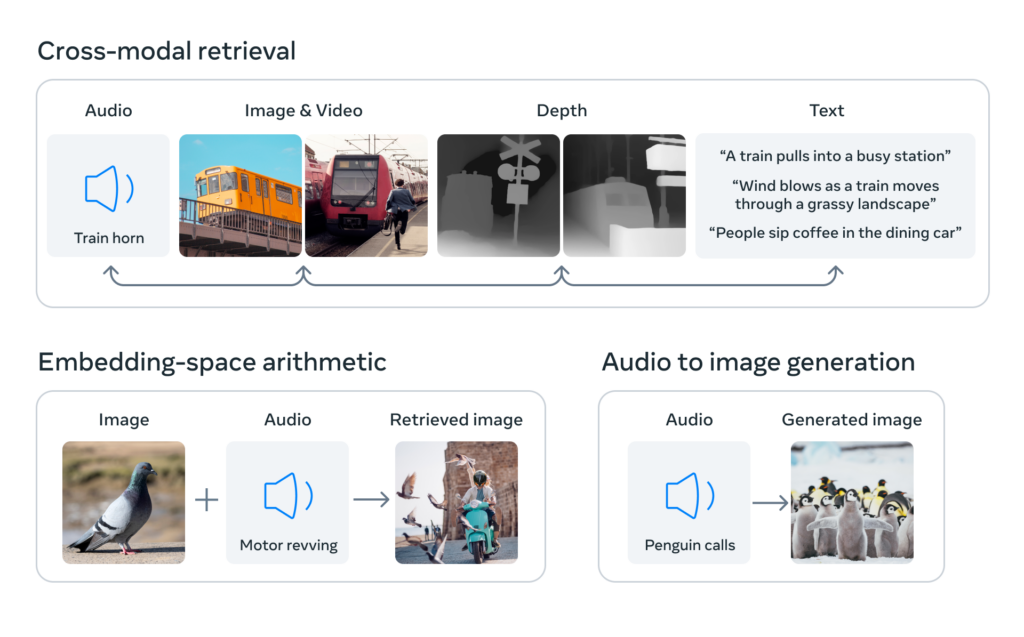

O modelo reúne dados de texto, imagem/vídeo e áudio, além de informações de sensores que registram profundidade (3D), temperatura (radiação infravermelha) e unidades de medição inercial (IMU), que calculam movimento e posição.

Essa forma de “aprendizado holístico”, como descreveu a própria Meta, abre novas possibilidades no campo da IA.

“Por exemplo, usando o ImageBind, o Make-A-Scene da Meta pode criar imagens a partir de áudio, como criar uma imagem baseada nos sons de uma floresta tropical ou de um mercado movimentado. Outras possibilidades futuras incluem maneiras mais precisas de reconhecer, conectar e moderar conteúdo e impulsionar o design criativo, como gerar mídia mais rica de maneira mais integrada e criar funções de pesquisa multimodais mais amplas”, explica postagem publicada pela Meta.